1. 서 론

2. 선행연구

2.1 LLM과 RAG 기반 법규 질의응답

2.2 법령의 계층·참조 구조를 반영한 검색추론 전략

2.3 지식그래프 GraphRAG 기반 다단계 근거 회수

2.4 건축 분야 RAG 적용 사례

3. 방법론

3.1 연구 개요

3.2 데이터 구성

3.3 법령 지식그래프 구축

3.4 GraphRAG 질의처리: Entity Linking–Multihop Retrieval–Generation

4. 실험 설계 및 평가 방법

4.1 검증 설계

4.2 평가 지표

5. 실험 결과 및 고찰

6. 결 론

1. 서 론

건축 인허가 및 건축 관련 민원 처리는 공공 안전과 재산권 보호를 위한 핵심 행정서비스이나, 실무에서는 다층적 법규 체계와 해석 불확실성으로 인해 과도한 검토 부담과 지연 비용이 발생한다. 건축공간연구원(Cho and Kim, 2024) 보고에 따르면, 건축 인허가를 위해 직접 참조해야 하는 법령만 200여 개에 이르며, 실제 행정 과정에서는 800개 이상의 세부 법령 및 관련 사례까지 검토가 요구된다. 또한 전국 243개 인허가 기관이 연간 평균 1,000건 이상의 인허가를 처리하는 가운데, 국토교통부에 접수되는 건축 관련 질의도 연간 약 1만 건 수준으로 제시되어(Cho and Kim, 2024) 법규 검토 및 질의 대응의 누적 부담이 구조적으로 큰 것으로 나타난다.

이와 같은 처리 지연과 해석 불일치는 경제적·법적 리스크로 직접 연결된다. 예컨대 건축 허가가 1개월 지연될 경우 민간공사에서 약 9,213억 원(아파트 건축 약 2,856억 원)의 추가 이자 비용이 발생할 수 있다는 추산이 제시된 바 있으며, 이는 인허가 지연이 금융비용 증가로 즉시 전이될 수 있음을 시사한다. 또한 위법 사항이 사후에 확인될 경우 시정명령 및 이행강제금 부과로 이어질 수 있는데, 「건축법」은 시정명령이 이행될 때까지 이행강제금을 ‘1년에 2회 이내’ 범위에서 반복 부과·징수할 수 있도록 규정한다. 따라서 인허가 단계에서의 법규 해석 오류 또는 근거 누락은 행정처분 및 분쟁을 통해 비용과 시간을 추가로 증폭시킬 수 있다.

최근 대규모 언어모델(LLM)은 자연어 질의응답에 강점을 보이며 법령 해석 지원에도 활용 가능성이 확대되고 있으나, 근거 없는 생성(환각)과 예외·단서적용 오류는 고위험 실패 모드로 남아 있다. 이를 보완하기 위한 대표적 접근이 검색증강생성(RAG)이며, RAG는 외부 지식(문서 검색 결과)을 생성 과정에 결합함으로써 사실성 및 근거 제시 가능성을 높인다(Lewis et al., 2020).

그러나 건축 법규 질의는 조문 간 인용·준용·위임과 같은 관계 기반 추론을 다수 단계로 요구하는 경우가 많아, 벡터 유사도 중심 검색만으로는 필요한 근거의 연쇄(정의 → 적용대상 → 예외/단서 → 관련 규정)를 안정적으로 회수하기 어렵다. 결과적으로 검색 단계의 근거 누락이 답변의 법적 합치성 및 설명가능성 저하로 이어질 수 있다.

이러한 한계를 완화하기 위해, 최근 GraphRAG(Graph-based RAG)는 지식그래프(노드–엣지 구조)에 문서/엔티티 및 관계를 명시적으로 표현하고, 질의 시 그래프 탐색을 통해 다단계 연계 근거를 회수하는 접근으로 제안되고 있다. Microsoft Research는 GraphRAG가 문서 집합에서 그래프를 구성하고 이를 질의 시 활용함으로써, 단순 RAG 대비 복합 질의(다문서/다단계 추론)에서 성능 개선을 보고하였다(Edge et al., 2024).

본 연구는 건설(건축) 민원 질의응답을 대상으로, 법령 조문 및 민원 데이터를 지식그래프로 구조화하고 GraphRAG 기반 질의응답 시스템을 개발·평가하는 것을 목표로 한다. 구체적으로 건축법 등 주요 법률을 포함한 10개 법률의 5,801개 조문을 기반으로 지식그래프를 구축하고, (i) 질의에서 핵심 법률 용어 및 조문을 식별하는 Entity Linking, (ii) 참조·포함 관계를 따라 연쇄 근거를 확장하는 Multihop Retrieval, (iii) 확장된 법령 집합을 문맥으로 제공하여 근거 중심 답변을 생성하는 Contextual Answer Generation을 결합한 파이프라인을 구현한다.

본 연구의 연구질문은 다음과 같다. (RQ1) GraphRAG는 벡터 기반 RAG 대비 건축 법규 질의응답의 정확도(Accuracy)를 향상시키는가? (RQ2) 관계 기반 멀티홉 근거 확장(GraphRAG)은 어떤 유형의 질의에서 상대적으로 유리하며, 그 과정에서 나타나는 주요 성공/실패 패턴과 한계(시드 민감성, 비관련 조문 유입 등)는 무엇인가? 본 연구는 동일 질의 세트 기반 비교 실험을 통해 정확도를 정량적으로 평가하고, 범주별 결과 및 대표 사례 기반 오류 분석을 통해 GraphRAG의 효용과 한계를 논의하며, 건축행정 AI 도입에 필요한 설계·운영상의 시사점을 도출한다.

2. 선행연구

2.1 LLM과 RAG 기반 법규 질의응답

대규모 언어모델(LLM)은 자연어 질의응답에 강점을 가지나, 최신 법령·유권해석·판례와 같은 외부 지식을 모델 파라미터만으로 항상 보장할 수 없어 근거 없는 생성(환각)과 조문 적용 오류가 빈번히 보고된다. 이를 완화하기 위한 대표적 방법이 검색증강생성(RAG)이며, RAG는 외부 문서 검색 결과를 생성 과정에 결합함으로써 사실성 및 출처 제시 가능성을 높인다(Lewis et al., 2020).

다만 RAG는 ‘검색-생성’ 파이프라인의 어느 단계에서든 오류가 전파될 수 있으며, 특히 검색 단계의 누락·편향은 최종 답변의 법적 합치성과 설명가능성 저하로 직결된다. Barnett et al.(2024)은 다양한 도메인 사례를 바탕으로 RAG 시스템 설계·운영 과정에서 발생 가능한 실패 지점을 정리하며, 운영 중 검증과 지속적 개선의 필요성을 강조하였다(Barnett et al., 2024).

국내 연구에서도 법률 문서에 특화된 검색·문맥 구성 전략을 통해 성능을 향상시키려는 시도가 보고되었다. 예를 들어 Shin et al.(2025)은 민법의 계층 구조를 반영한 모듈형 RAG 기반 한국어 법률 QA 시스템을 제안하여, 조문 체계의 구조화와 단계적 문맥 제공이 법률 질의응답의 안정성에 기여할 수 있음을 보였다. 건축행정 영역에서는 Cho and Kim(2024)이 LLM을 활용한 건축민원 대응 지원 시스템을 제안하고, 벡터 기반 검색을 통해 관련 조문을 근거로 제시하는 방식의 가능성을 논의하였다.

또한 최근에는 신뢰 가능한 근거가 확보되지 않을 경우 생성 전략을 변경하거나, 다중 모델 앙상블·사람 검토를 결합하는 ‘에이전트형(Agentic)’ 법률 QA가 제안되고 있다. Xi et al.(2025)은 사법 포렌식 도메인에서 근거 검색을 우선 적용하고, 검색 실패 시 다수 LLM의 후보 답변을 선택·검증하며, 검토 결과를 지식베이스에 반영하는 하이브리드 에이전트를 제안하였다. 이는 법률 질의응답에서 ‘근거 회수의 실패’를 사전에 탐지·완화하는 메커니즘이 필요함을 시사한다.

2.2 법령의 계층·참조 구조를 반영한 검색추론 전략

법령은 법률–시행령–시행규칙 등 위계 구조와 더불어 조·항·호·목의 세부 계층을 가지며, 조문 간 인용·준용·위임·정의 참조가 빈번하다. 특히 건축법 체계는 적용대상(정의)–기준(본칙)–예외/단서–관련 고시·규칙으로 근거가 연쇄되는 경우가 많아, 단일 조문 또는 단일 문서 조각만을 근거로 답변할 때 누락 가능성이 높다.

이와 관련하여 Lee and Lee(2025)는 건축법규 해석에서 긴 문맥(long context window)을 활용한 제로샷(Zero-shot) 해석 프레임워크를 제안하고, RAG 기반 방식이 조문 분할(Chunking)로 인한 문맥 단절 및 다단계 추론 한계를 가질 수 있음을 지적하였다(Lee and Lee, 2025). 또한 MultiHop-RAG 벤치마크는 여러 근거를 거쳐야 하는 멀티홉 질의에서 기존 RAG가 근거 회수와 추론 모두에서 취약함을 실험적으로 보고하였다(Tang and Yang, 2024). 이는 건축 민원 질의처럼 ‘정의 → 적용대상 → 예외/단서 → 관련 규정’의 연쇄를 요구하는 문제에서, 검색 단계부터 다단계 구조를 반영할 필요가 있음을 보여준다.

2.3 지식그래프 GraphRAG 기반 다단계 근거 회수

법령의 계층 구조와 조문 간 관계를 명시적으로 모델링하기 위한 접근으로 지식그래프(Knowledge Graph, KG)가 활용된다. 법제처는 ‘지능형 법령검색 서비스’ 고도화 과정에서 질의에서 추출한 용어를 기반으로 지식그래프를 활용한 시각화 검색 기능을 도입하고, 관련 개념을 단계적으로 따라가며 필요한 조문을 탐색할 수 있도록 지원하고 있다.

최근 GraphRAG는 그래프 기반 구조를 결합해 ‘관계’를 단서로 근거를 확장·조합하는 RAG의 변형으로 제안되고 있다. Edge et al.(2024)은 대규모 문서 집합에서 엔티티 그래프를 구축하고 커뮤니티 요약(community summary)을 생성한 뒤, 이를 질의 시 조합하여 전역적 질문에 답하는 GraphRAG 접근을 제시하였다. 한편 Jin et al.(2025)은 네트워크형 문서(인용 그래프, 소셜미디어, 지식그래프 등)에서 텍스트 조각을 ‘서브그래프’로 회수하고 그래프 토폴로지 정보를 함께 제공하는 GRAG 모델을 제안하여 멀티홉 추론 성능 개선을 보고하였다.

2.4 건축 분야 RAG 적용 사례

건축행정 분야에서는 법령 질의응답의 실무 적용 가능성을 검증하는 시스템 연구가 보고되고 있다. 건축공간연구원(AURI)은 LLM과 RAG를 결합한 건축법령 해석 지원 시스템 Archilaw를 개발·고도화하였으며, Archilaw V2에 대해 공무원 답변과의 일치율 78% 및 사용자 만족도 60.4% 등을 보고하였다(Cho and Kim, 2024). 해당 사례는 건축 민원 처리에서 ‘법령 검색·해석 시간 단축’과 ‘업무 부담 완화’라는 실무적 가치가 크다는 점을 보여준다. 다만 보고서에서도 멀티턴 대화 맥락 관리, 생성 답변 품질 검증, 법령 개정의 실시간 반영 등은 여전히 도전 과제로 제시된다

선행연구를 종합하면, 법규 질의응답에서 RAG는 근거 제시를 통해 환각을 완화할 수 있으나, (i) 검색 단계의 누락·편향이 생성 오류로 전이될 수 있고(Barnett et al., 2024), (ii) 조문 분절 및 top-k 중심 회수 전략은 정의·예외·단서·준용조항처럼 “연쇄적으로 함께 제시되어야 하는 근거”를 동시에 포착하지 못할 가능성이 있으며(Lee and Lee, 2025), (iii) 멀티홉 질의에서 근거 회수·추론의 취약성이 관찰된다(Tang and Yang, 2024). 따라서 본 연구는 특히 (ii)~(iii)에 해당하는 ‘연쇄 근거 누락’과 ‘관계 기반 다단계 근거 회수의 불안정성’을 건축(건설) 민원 법령해석 QA의 주요 연구 과제로 설정한다.

이에 본 연구는 법령의 계층 구조와 조문 간 인용·준용·위임 관계를 지식그래프로 모델링하고, 질의에서 식별된 시드 조문을 기점으로 그래프 탐색을 통해 관련 근거를 멀티홉으로 확장·회수하는 GraphRAG 접근을 적용한다. 이를 통해 (RQ1) 벡터 기반 RAG 대비 정확도 향상 여부와, (RQ2) 어떤 질의 유형에서 상대적으로 유리한지 및 주요 성공/실패 패턴(시드 민감성, 비관련 조문 유입 등)을 비교 실험과 오류 분석으로 검증한다.

3. 방법론

3.1 연구 개요

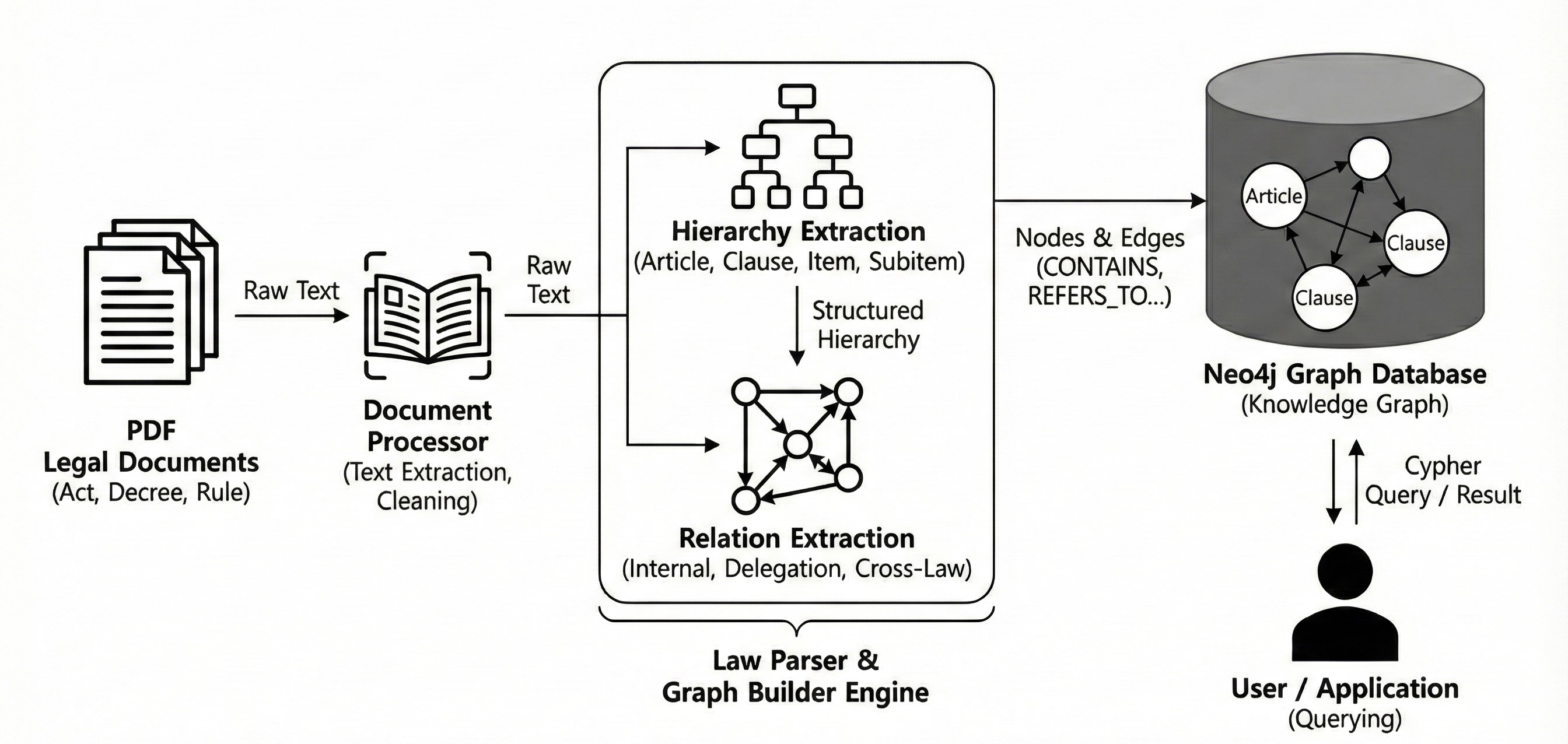

본 연구는 건축(건설) 민원 법령해석 질의응답을 대상으로, 법령 조문 및 조문 간 관계를 지식그래프(Knowledge Graph, KG)로 구조화하고 이를 검색증강생성(Retrieval-Augmented Generation, RAG)에 결합한 GraphRAG 기반 질의응답 파이프라인을 설계·구현한다. 제안하는 파이프라인은 (1) 법령 코퍼스의 계층 및 참조 구조를 반영한 KG 구축, (2) 질의에서 핵심 법률 용어 및 관련 조문을 식별하는 Entity Linking, (3) 그래프 순회 기반의 Multihop Retrieval을 통한 연쇄 근거 확장, (4) 확장된 근거를 문맥으로 제공하여 답변을 생성하는 Contextual Answer Generation으로 구성된다(Fig. 1). 또한 동일한 질의 세트에 대해 벡터 기반 RAG와 비교 평가를 수행하여, 정확도 차이와 함께 질의 유형별로 GraphRAG의 유효 조건 및 실패 패턴을 분석한다.

3.2 데이터 구성

지식그래프 구축에는 건축법을 포함한 10개 법률의 총 5,801개 조문을 사용한다. 성능 평가는 국토교통부에서 23년도에 발간한 건축법령 질의회신집의 171개 법령해석 질의 세트를 대상으로 수행하며, 각 질의는 질문과 정답(모범답변)을 포함한다.

3.3 법령 지식그래프 구축

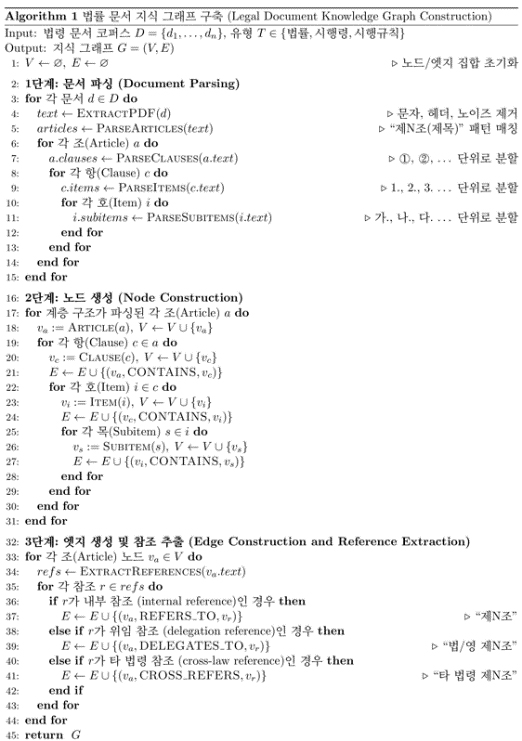

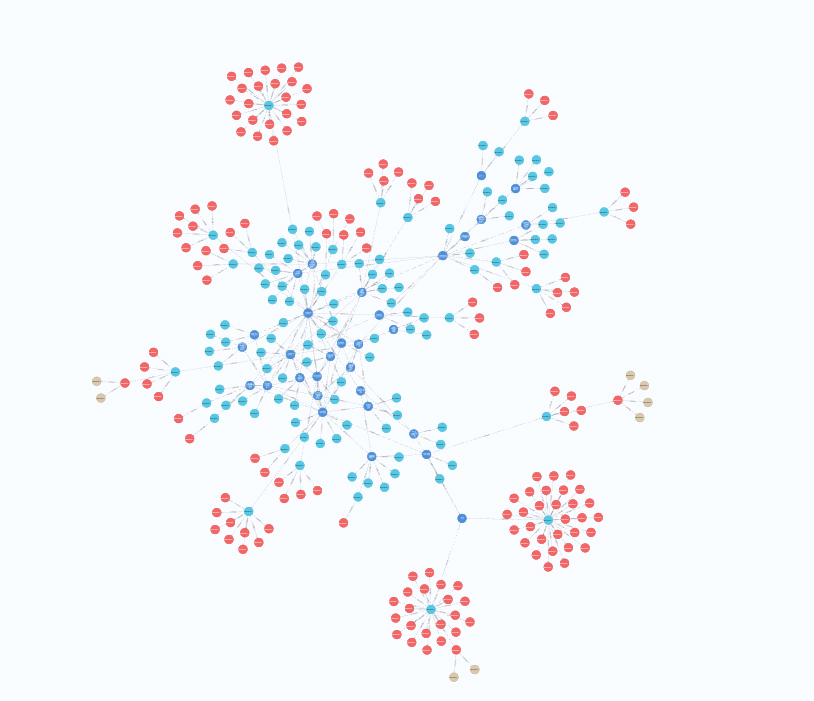

법령 지식그래프는 법령의 조문 체계를 그래프 구조로 재현하는 것을 목표로 한다. 이를 위해 조·항·호·목 등 계층 구조를 파싱하여 노드(V)로 정의하고, 상위–하위 포함 관계를 엣지(E)로 연결한다. 또한 조문 본문에 포함된 인용·준용·위임 등 참조 표현을 추출하여 조문 간 참조 관계 엣지를 구성한다. 지식 그래프 구축 절차는 Fig. 2에 요약하였으며, 구축 지식그래프의 시각화 예시는 Fig. 3에 제시한다. 구축된 KG는 그래프 DB에 적재되며, 질의 시 그래프 탐색을 통해 조문 간 연쇄 근거를 확장·회수하는 데 사용된다.

3.4 GraphRAG 질의처리: Entity Linking–Multihop Retrieval–Generation

GraphRAG는 질의 처리 과정에서 단순 유사도 기반 검색으로는 누락될 수 있는 정의, 예외, 단서, 연계 규정 등 연관 조문을 관계 중심으로 확장·회수하는 것을 목표로 하며, 이를 위해 Entity Linking–Multihop Retrieval–Contextual Answer Generation의 단계적 절차를 따른다. 먼저 Entity Linking 단계에서는 질의로부터 핵심 법률 용어와 조문 후보를 식별하여 그래프 탐색의 시작점이 되는 시드 노드 집합(S)를 구성하며, 질의에 조문 번호(예: “제○조”)가 명시된 경우 해당 조문을 우선적으로 시드로 채택하고, 명시적 표기가 없는 경우에는 OpenAI의 text-embedding-ada-002 임베딩 모델을 활용한 벡터 기반 의미 유사도 검색을 통해 조문 후보를 확보한다. 이후 Multihop Retrieval 단계에서는 시드 노드(S)에서 출발하여 그래프 내 포함 관계 및 참조 관계 엣지를 따라 인접 노드를 반복적으로 확장함으로써 정의 조문에서 적용 요건, 예외 및 단서, 관련 규정으로 이어지는 다단계 연결 근거를 체계적으로 회수한다. 마지막으로 Contextual Answer Generation 단계에서는 그래프 탐색을 통해 수집된 조문 집합을 문맥 패키지로 구성하여 생성 모델에 입력하고, 중복 조문을 제거한 뒤 정의 조문과 직접 적용 조문을 우선 배치하고 예외·단서 및 참조 확장 조문을 후순위로 정렬함으로써, 근거에 기반한 일관된 답변을 생성한다.

4. 실험 설계 및 평가 방법

4.1 검증 설계

본 연구는 Cho and Kim(2024)이 사용한 건축 민원 법령해석 질의응답 평가 설정을 준용하여, 동일한 171개 법령해석 질의 세트에서 GraphRAG의 성능을 평가한다.

비교 기준선으로는 Cho and Kim(2024)에서 동일한 질의세트에 대해 성능이 보고된 벡터 기반 RAG인 SPARC Precision을 사용하여, 제안 방법을 도메인 내 선행 기준과 직접 비교한다.

(A) 기준선 SPARC Precision(벡터 기반 RAG)은 법령 조문을 임베딩 기반 벡터 데이터베이스에 적재한 뒤 질의–조문 간 의미 유사도 기반으로 상위 k개 조문을 회수하고, 회수된 조문을 근거 문맥으로 제공하여 LLM이 답변을 생성하는 방식이다. (B) 제안 방법은 본 연구의 GraphRAG로, (i) 질의에서 핵심 용어/조문을 식별하여 시드(seed)를 설정한 뒤, (ii) 법령 지식그래프의 포함·참조 관계를 따라 멀티홉으로 근거를 확장·회수하고, (iii) 확장된 조문 집합을 근거로 답변을 생성한다.

단, (A)의 정확도는 Cho and Kim(2024)에 보고된 결과를 인용하여 비교하는 방식이므로, 생성 모델 버전, 프롬프트 템플릿, 문맥 길이 예산 등 세부 실행 환경이 본 연구의 GraphRAG 실행 환경과 완전히 동일하다고 단정할 수는 없다. 따라서 본 절의 비교는 동일 평가셋 기준에서 GraphRAG가 선행연구의 벡터 기반 RAG 기준선 대비 어느 수준의 정확도 개선을 보이는지 확인하는 참고 비교로 해석한다.

4.2 평가 지표

정량 평가는 Cho and Kim(2024) 연구의 성능평가 방식과 동일하게 정확도(Accuracy) 단일 지표만을 사용한다. 각 질의에 대해 시스템 답변이 모범답변과 결론 수준에서 일치하면 정답으로 판정하고, 전체 질의에서 정답 비율을 정확도로 보고한다.

5. 실험 결과 및 고찰

본 연구의 GraphRAG 모델은 171개 법령해석 질의에 대해 정확도 59.1%(101/171)를 보였다. 비교 기준선인 SPARC Precision(벡터 기반 RAG)은 동일한 171개 질의 세트에 대해 56.1%(96/171)로 보고되었다. 이를 기준으로 보면, GraphRAG는 기준선 대비 2.9%p 높은 정확도를 보였다(Table 1 참고).

이러한 성능 차이는 건축 법규 질의의 특성상 단일 조문의 검색만으로는 해결하기 어려운 복합적인 추론이 요구되기 때문으로 분석된다. 즉, GraphRAG가 지식그래프의 연결 관계를 활용하여 정의, 예외, 단서 조항 등 연쇄적으로 연결된 법적 근거를 문맥(Context)으로 제공함으로써, 생성 모델이 보다 정확한 판단을 내리는 데 기여했음을 시사한다.

다만 Table 1의 범주별 질의 수는 일부 항목에서 2~6개 수준으로 작아, 범주별 정확도 차이는 통계적 확정이라기보다는 성능 변화가 관찰된 ‘경향’으로 해석한다. 범주별 상세 분석 결과, ‘건축허가 취소(Cancellation of Building Permits, +40%p)’, ‘건축설비(Building Facilities, +20%p)’, ‘피난·소방(Fire Escape and Firefighting, +13.3%p)’, ‘일조 높이제한(Height Restrictions for Sunlight, +12.5%p)’ 등의 항목에서 뚜렷한 성능 개선이 관찰되었다. 이들 범주는 법령 구조상 상위 조문에서 하위 조문으로의 위임이나, 본문에서 예외/단서로 이어지는 참조 관계가 빈번하다는 특징이 있다. 이는 GraphRAG의 멀티홉(Multihop) 검색 방식이 조문 간의 명시적 관계를 따라 탐색 범위를 확장함으로써, 단순 벡터 유사도 검색이 놓칠 수 있는 논리적 연결 고리를 효과적으로 포착했기 때문으로 해석된다.

Table 1.

Performance Comparison with Previous Studies

반면, ‘대지와 도로(Land and Roads)’ 범주에서는 오히려 정확도가 25%p 하락하였으며, 다수의 범주에서 성능 차이가 없거나 미미한 것으로 나타났다. 이러한 현상은 GraphRAG의 검색 품질이 그래프 탐색의 시작점이 되는 ‘시드(Seed)’ 선정(Entity Linking)의 정확도에 크게 의존하기 때문에 발생한 것으로 보인다. 질의의 핵심 조문을 정확히 식별하지 못할 경우, 그래프 확장이 오히려 질의와 무관한 조문들을 문맥에 유입시키는 노이즈(Noise)로 작용하여 모델의 판단을 흐리게 할 가능성이 있다. 또한, 단일 조문 참조만으로 충분한 단순 질의의 경우, 복잡한 관계 확장이 불필요하거나 오히려 효율을 저하시킬 수 있음을 보여준다.

딥러닝 관점에서 보면, GraphRAG의 멀티홉 확장은 근거 회수의 재현율(recall)을 높이는 대신 문맥에 포함되는 조문 수가 증가하면서 정밀도(precision)가 낮아질 수 있다. 이 경우 생성 모델은 회수 문맥에 포함된 비관련 또는 상충 근거에 의해 산만해져 오답을 선택하거나 환각(hallucination)을 유발할 위험이 커진다. 실제로 retrieval-augmented language model (RALM) 연구에서는 회수 문맥이 비관련일 때 정확도가 오히려 감소할 수 있으며, 무관 문맥이 오류를 유발하는 핵심 요인임을 실험적으로 보고하였다(Yoran et al., 2024; Shi et al., 2023).

또한 GraphRAG는 그래프 확장 과정에서 다수의 조문(다문서/다조각)을 동시에 제공하는 경향이 있어 ‘다문서 처리’ 자체가 추가 난이도로 작용할 수 있다. Levy et al.(2025)은 총 토큰 길이를 고정하더라도 문서 개수가 증가하면 LLM 성능이 유의하게 감소하는 경향을 보이며, 이는 문서 간 중복·충돌 정보 및 암묵적 관계를 모델이 효과적으로 통합하지 못하기 때문일 수 있음을 보였다. 더불어 긴 문맥에서는 관련 정보가 문맥의 가운데에 위치할 때 활용도가 감소하는 ‘lost-in-the-middle’ 현상이 관찰되어(Liu et al., 2024), 과도한 확장으로 핵심 조문이 문맥의 중간/후반으로 밀릴 경우 답변 정확도가 저하될 가능성이 있다.

종합하면, GraphRAG는 복잡한 참조 구조를 가진 법령 질의에 대해 벡터 기반 검색보다 우수한 근거 회수 능력을 보이나, 시드 선정 오류 또는 과도한 멀티홉 확장으로 비관련 근거가 유입될 경우 다문서/장문 문맥 처리 한계로 인한 성능이 저하될 수 있다. 따라서 실무 적용을 위해서는 초기 시드 조문의 정확한 식별과 함께, 확장 근거의 관련성 재랭킹(reranking),필터링 및 문맥 구성의 제어가 병행되어야 함을 시사한다.

6. 결 론

본 연구는 건축(건설) 민원 법령해석 질의응답에서 조문 간 계층 구조와 인용·준용·위임 관계를 근거 회수 과정에 반영하기 위해, 법령 조문과 관계를 지식그래프로 구조화하고 그래프 탐색 기반 근거 확장을 결합한 GraphRAG 파이프라인을 설계·구현하였다. 이는 벡터 유사도 중심 RAG가 정의–요건–예외/단서–연계 규정 등 “연쇄적으로 함께 제시되어야 하는 근거”를 안정적으로 동시 회수하기 어렵다는 한계를 완화하려는 접근이다.

RQ1에 대해, GraphRAG는 171개 법령해석 질의에서 59.1%(101/171)의 정확도를 보였고, 선행연구에서 동일 평가셋에 대해 보고된 벡터 기반 RAG 기준선(56.1%, 96/171) 대비 약 2.9%p 높은 정확도가 관찰되었다. 다만 기준선은 선행연구의 보고값을 인용한 것이므로 생성 모델, 프롬프트, 문맥 예산 등 실행 환경의 동일성이 보장되지 않으며, 본 결과는 동일 평가셋 기준의 참고 비교로 해석되어야 한다. 향후에는 동일 실행 환경에서의 재현 실험을 통해 성능 차이를 보다 엄밀히 검증할 필요가 있다.

RQ2에 대해, GraphRAG의 이점은 조문 간 참조·위임·예외/단서가 연쇄되는 질의 유형에서 상대적으로 두드러지게 관찰되었으며, 이는 관계 기반 멀티홉 탐색이 관련 근거의 동시 회수 가능성을 높였기 때문으로 해석된다. 반면 시드 조문 선정 오류가 발생하거나 비관련 조문이 문맥에 과도하게 유입될 경우 정확도가 하락할 수 있었고, 단일 조문 수준에서 결론이 결정되는 단순 질의에서는 관계 확장의 추가 이점이 제한적으로 나타났다. 따라서 GraphRAG의 실무 적용을 위해서는 ‘시드 선정 정확도’와 ‘확장 근거의 관련성 제어’가 핵심 운영 변수로 작동함을 시사한다. 이는 비관련 문맥이 포함될 때 LLM이 산만해져 성능이 저하될 수 있다는 선행 보고(Shi et al., 2023; Yoran et al., 2024) 및 다문서 근거가 증가할 때의 성능 저하 경향(Levy et al., 2025)과도 맥락을 같이한다.

향후 연구에서는 (1) 법령 용어/표현 변이 및 동의어를 고려한 Entity Linking 고도화, (2) 확장 근거의 관련성 재랭킹 및 불필요 근거 제거를 통한 문맥 정제, (3) 질의 유형에 따라 탐색 예산(홉 수/회수 노드 수/문맥 길이)을 적응적으로 조정하는 정책, (4) 법령 개정 반영 및 답변 검증(휴먼 인 더 루프 포함) 체계 결합을 통해, 정확도뿐 아니라 설명가능성과 운영 안정성을 함께 향상시키는 방향의 확장이 필요하다.